Logiciels obsolètes : comment changer de logiciel avec un historique important ?

Récemment, une personne de mon entourage m’a partagé quelques anecdotes surprenantes sur l’entreprise où elle travaille. C’est une grande PME, bien ancrée dans son secteur, souvent citée comme un modèle d’innovation et de réussite par les PME et TPE locales. Pourtant, au détour de la conversation, j’apprends une nouvelle inattendue : leur éditeur d’ERP vient de mettre la clé sous la porte.

Le plus compliqué ? Aucune mesure n’a été anticipée en interne. Pas de plan B, pas de transition en vue. Une situation délicate, qui peut sembler surprenante à plusieurs égards : comment un éditeur peut-il arrêter le développement de ses produits du jour au lendemain ? Comment une entreprise peut s’en prémunir et rebondir ?

Explorons ensemble les enjeux sous-estimés de l’obsolescence informatique.

Sommaire

#1 – L’obsolescence logiciel, ce n’est pas qu’une histoire de matériel

#2 – Pourquoi est-ce qu’un éditeur arrête-t’il de maintenir ses logiciels ?

#3 – Comment on en arrive là ?

#4 – Concrètement, qu’est-ce qu’on risque à maintenir des logiciels obsolètes ?

#5 – Comment anticiper le vieillissement de vos logiciels professionnels ?

L’obsolescence logiciel, ce n’est pas qu’une histoire de matériel

Sur les 2 dernières années, les feuilles de route de progiciels leaders, ont été fortement marquées par des arrêts de mise à jour, de compatibilité, voire de commercialisation :

- L’éditeur Sage a retiré plusieurs versions de Sage 100, Sage 50 et Ciel

- Cegid a planifié l’arrêt progressif de Quadra Compta, au profit de Cegid Loop

- Microsoft a officiellement validé la mise en arrêt total de Skype pour le 5 mai 2025. Cet arrêt avait été annoncé et progressivement accompagné depuis 2019, au profit de Teams

- Microsoft Dynamics GP, ERP utilisé en TPE et PME, a annoncé arrêter l’application en 2025...

Chez Cool IT, l’obsolescence des progiciels, c’est la moitié de nos accompagnements depuis 2020. On pourrait croire qu’il s’agit de cas isolé, de petites entreprises désorganisées, éloignées du numérique. Et pourtant !

Pas plus tard qu’en 2023, le géant de la distribution Gifi a entrepris une migration vers un nouvel ERP, pour endiguer des problèmes de logiciels métiers vieillissants. Cette transition dantesque a produit des dysfonctionnements nombreux : stocks affectés, retard de livraison en point de vente, ralentissement de l’activité…Ces dysfonctionnements ont par ailleurs généré une dette conséquente, toujours soutenue actuellement par l’état.

Pourquoi est-ce qu’un éditeur arrête-t-il de maintenir ses logiciels ?

L’arrêt des mises à jour d’un logiciel est une situation courante. Dans l’édition de logiciel, il y a plusieurs facteurs qui poussent à arrêter de maintenir un logiciel :

- Les technologies sont devenues obsolètes et ne bénéficient plus de mises à jour officielles

- L'éditeur développe une nouvelle version du logiciel et abandonne progressivement l'ancienne

- Il devient difficile de trouver des développeur·euses maîtrisant la technologie utilisée

- Les coûts de maintenance (serveurs, développement…) deviennent trop élevés

- Le logiciel n’est plus rentable

Un logiciel, même largement adopté et pleinement fonctionnel, n’est jamais garanti de durer. La confiance accordée aux outils informatiques doit rester mesurée, que ce soit vis-à-vis de l’éditeur (sa présence sur le marché, sa santé financière, les technologies employées…) ou des évolutions constantes du secteur de la tech.

Pourquoi continuer à utiliser des logiciels obsolètes ?

L’informatique en entreprise, c’est tout récent. La démocratisation de l’ordinateur dans les PME n’arrive pas avant la fin des années 80, tandis que l’introduction d’internet ne s’établit réellement qu’à la fin des années 90.

En 30 ans, nous sommes passés de l’informatique de bureau basique, avec des ordinateurs lourds et peu connectés, à un monde ultra-connecté, mobile et axé sur les données. En entreprise, l’informatique n’évolue que si le client final évolue. En fonction des territoires, des secteurs Tech ou non Tech, il y a des écarts de transformation numérique, qui peuvent amener à un décalage avec les éditeurs de logiciel. Pour une entreprise qui n’est pas dans la Tech, tant qu’un système tourne, il est normal de ne pas se poser la question de son obsolescence.

- Un historique de données de plusieurs années qu’on ne souhaite pas perdre

- Un manque de temps pour former les utilisateurs sur un nouveau logiciel

- Des habitudes bien ancrées, avec un rapport difficile au changement

- Des liaisons bidouillées et multiples avec ce logiciel, et on ne sait pas ce qu’il va en advenir si on change

- Un manque de compétences numériques à jour

- Un manque de disponibilité pour piloter les évolutions...

Ces raisons sont tout à fait légitimes ! Cependant, utiliser un logiciel obsolète pendant trop longtemps, c’est renforcer un certain nombre de risques qui vont au-delà de l’informatique.

Concrètement, qu’est-ce qu’on risque à maintenir des logiciels obsolètes ?

Les logiciels c’est immatériel, on ne voit pas tout de suite s’il y a de la casse.

D’autant plus que les effets d’un logiciel vieillissant, mettent du temps à se voir. Et quand bien même, on les a identifiés, on met en place des rustines, des détournements pour continuer à les utiliser.

Pourtant, un environnement numérique défaillant peut entraîner des problématiques qui ne sont pas que technologiques :

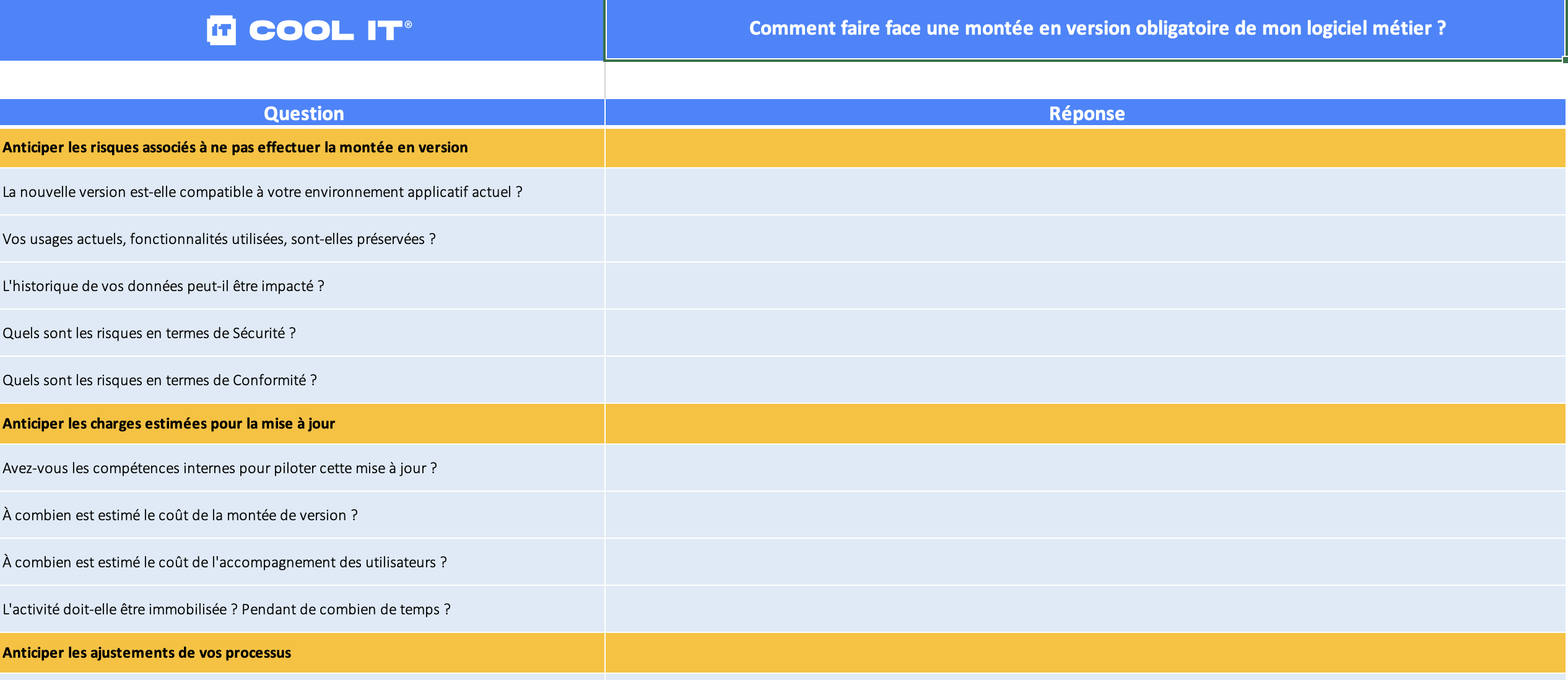

| 📌 Domaines impactés | 🔍 Détail des impacts |

| Impacts sur la productivité | – Augmentation des tâches chronophages – Écart d’information entre les services – Diffusion de données erronées – Ralentissement des projets – Retards opérationnel qui s’accumulent |

| Impacts sur la relation client | – Retard de livraison – Écart de prix – Stock incorrect – Personnel tendu, qui donne une mauvaise image de l’entreprise |

| Impacts sur les budgets | – Coût du support plus élevé, par manque de personnel qualifié – Temps de support plus long – Maintenance plus fréquente, à des tarifs plus élevés, qu’une technologie à jour |

| Impacts sur la cohésion | – Frustration et perte de motivation – Frein à la collaboration – Clivage entre les générations d’employés et les services – Risque de désengagement pour des entreprises mieux équipées |

| Impacts sur la compétitivité | – Frein à l’évolution des produits/services – Dévalorisation de la marque employeur – Perte de marché |

| Risques cyber accrus | Un logiciel qui n’est plus maintenu par un éditeur, c’est un logiciel avec des failles, qui n’est plus protégé |

| Risques juridiques | Un logiciel ancien, c’est un logiciel qui ne tient plus compte des conformités du droit numérique. En cas de données personnelles compromis, en raison d’un défaut de logiciel, la responsabilité de l’Entreprise peut être engagée |

Comment anticiper le vieillissement de vos logiciels professionnels ?

La responsabilité est partagée ! L’éditeur de logiciel a pour obligation de communiquer ses évolutions majeures, ses changements de tarifs, d’offre, et de prévoir un accompagnement adapté en cas d’arrêt d’un produit.

- Rester informer. Les actualités des éditeurs sont toujours publiques, via un e-mailing, une interface dédiée sur leur site officiel ou le chargé de compte

- Prévoir des audits réguliers des systèmes informatiques permettant de détecter les obsolescences en amont

- Se former aux bases de l’informatique professionnel, afin d’être en mesure de prendre les bonnes décisions

- Sonder régulièrement la satisfaction des salariés, quant à leur matériel et logiciel

Dépassé par l'obsolescence informatique ?

Pour ne pas laisser l’obsolescence de vos outils informatiques compromettre l’avenir de votre entreprise, vous pouvez faire appel à des experts, comme Cool IT, pour une mise à jour stratégique, un audit ou un accompagnement.